Décembre 2025. Votre algorithme d’IA diagnostique est un chef-d’œuvre technique. Vous avez la preuve clinique de sa performance (90% de réussite diagnostique). Pourtant, si vous n’agissez pas maintenant, il sera illégal après le 2 août 2026.

Le paradoxe de l’IA en santé n’est plus la technologie, mais la règlementation. L’ère de l’innovation rapide cède la place à l’ère de la Conformité Urgente.

Chez JuliaShift, nous observons que le risque majeur pour les scale-ups n’est pas le piratage, mais l’échec réglementaire dû au biais clinique et à l’imminence de l’EU AI Act.

Dans cet article, nous décryptons les trois éléments essentiels pour transformer ce risque en résilience : l’échéance critique du 2 Août 2026, le danger juridique des biais de données non gérés, et l’obligation d’un Human-in-the-Loop robuste.

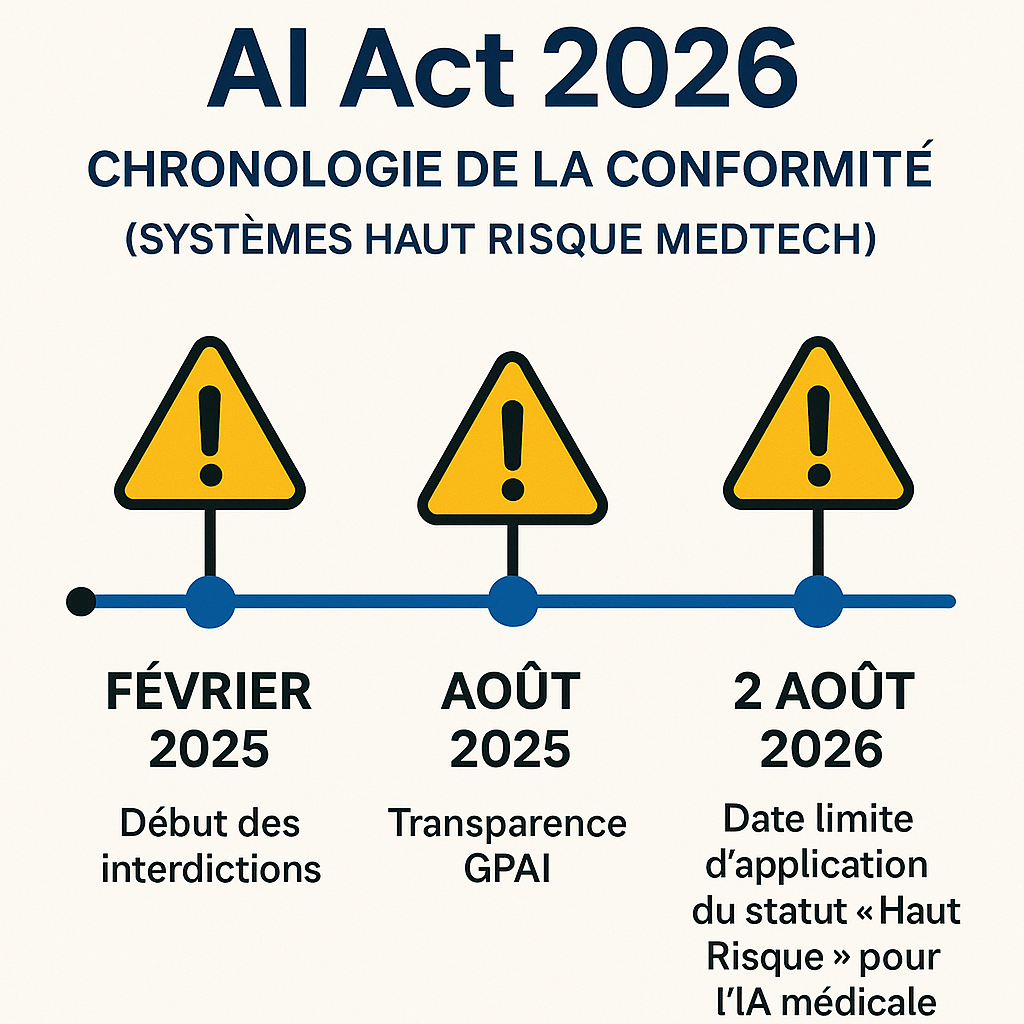

1. Le Chronomètre de la Sanction : AI Act & Statut Haut Risque

Le Règlement 2024/1689 (AI Act) n’est pas une suggestion, c’est une loi qui entre en vigueur progressivement. Oubliez la stratégie d’attente.

- Le Classement « Haut Risque » est Acté : Tous les systèmes d’IA de diagnostic et de prise de décision clinique sont classés HAUT RISQUE. Ceci impose un Système de Gestion des Risques (SGR) continu et une documentation complète, dès la mise en application.

- La Date Butoir : L’application des règles pour les systèmes à Haut Risque est fixée au 2 août 2026. C’est le délai ultime pour aligner vos processus d’ingénierie et votre documentation technique sur les exigences européennes (Source : CERTEAFILES, PMC).

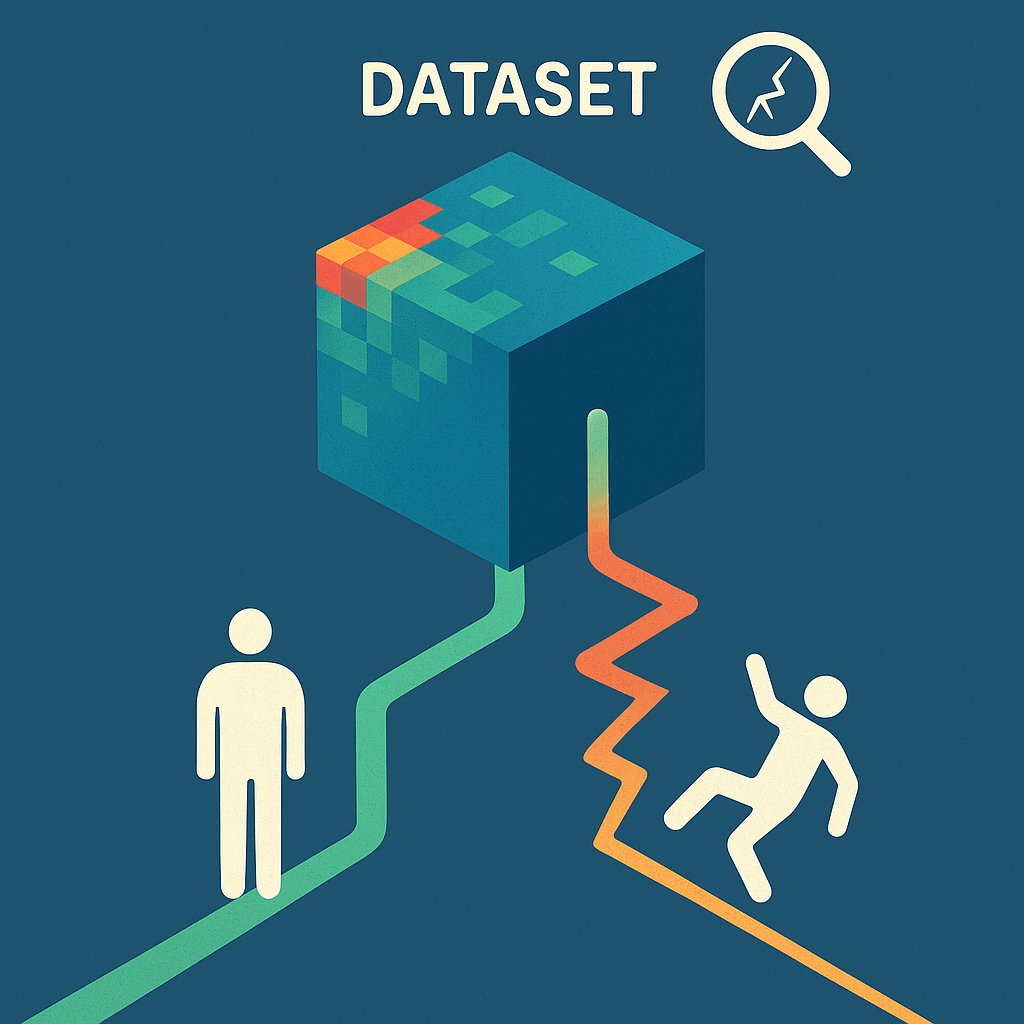

2. Le Danger Judiciaire du Biais : L’IA Discriminante

L’AI Act sanctionne l’iniquité. Votre IA pourrait être non conforme si elle sous-performe sur une partie de la population européenne.

- Le Chiffre de l’Inégalité : Le défaut de données représentatives (biais de genre ou de couleur de peau) dégrade la performance diagnostique. Le taux d’erreur peut passer de 1% (sur la population majoritaire) à un niveau dangereux de 35% sur les populations sous-représentées. C’est un risque d’invalidation clinique et de sanction légale.

- L’Hallucination : Les systèmes d’IA générative (LLMs) ont des performances diagnostiques élevées, mais produisent du contenu probabiliste. Le risque d’hallucination (données inventées ou obsolètes) exige une supervision stricte pour éviter l’erreur clinique.

3. Le Contrôle Humain : L’Obligation de la Résilience

Mots-Clés Cibles : Human-in-the-Loop Légal, Gouvernance IA MedTech, Responsabilité médicale IA.

L’AI Act impose la supervision. La HAS (Haute Autorité de Santé) fournit le cadre pratique de cette obligation en contexte français.

- Le HIL est la Loi : L’AI Act rend le « Human-in-the-Loop » (HIL) légalement obligatoire pour tous les diagnostics critiques. Le médecin conserve la responsabilité finale (Source : Mémoire Ariis).

- Le Cadre HAS : La HAS recommande aux cliniciens de s’approprier ces outils en suivant les 4 axes AVEC (Apprendre-Vérifier-Estimer-Communiquer) pour garantir le bon usage (Source : Guide HAS IA générative Oct 2025). C’est le framework de gouvernance que vous devez intégrer.

Conclusion Stratégique : L’Anticipation du Risque

L’heure n’est plus à la justification technologique, mais à la sécurisation réglementaire et éthique. Votre investissement le plus rentable est dans l’audit de vos jeux de données et de votre chaîne de conformité.

Question ouverte aux Dirigeants MedTech : Qui a validé l’absence de biais sur votre training set ? Votre DSI est-il prêt pour l’audit de l’AI Act en 2026 ?

🎯 CALL TO ACTION

Vous structurez la mise en conformité de vos systèmes d’IA pour 2026 ?

Nous vous accompagnons dans l’Audit de Robustesse Clinique et Réglementaire de vos systèmes d’IA existants. Ne laissez pas un biais clinique faire capoter votre stratégie marché.

👉 Réserver votre consultation stratégique

Vous souhaitez recevoir L’Éclaireur e-Santé chaque mois ? Retrouvez toutes nos analyses sur la newsletter.

🎯 Aller plus loin

Vous structurez une levée MedTech ?

Téléchargez gratuitement nos rapports stratégiques :

- Checklist 50 points conformité BPI France

- Timeline 0-6 mois pré-levée

- 3 cas startup (seed → série A)

- Frameworks valorisation multiples Revenue

📥 Télécharger vos rapports gratuits → Blueprint MedTech

À propos de l’auteur

Nicolas Schneider est conseiller stratégique en transformation numérique santé et fondateur de JuliaShift. Avec 17 ans d’expérience au Service de Santé des Armées et 8 ans en consulting transformation digitale, il accompagne les startups MedTech et établissements de santé dans leur stratégie de financement, structuration de partenariats pharma, et préparation de levées de fonds.

Spécialités : financement innovation santé, structuration levées de fonds MedTech, partenariats industriels pharma, conformité IA réglementaire.