En juin 2025, la DGOS lançait l’AMI IA Urgences. Résultat : 147 candidatures reçues, 74 établissements lauréats, 78 projets financés sur fonds France 2030. Un signal fort — et une nouvelle illustration de l’opacité institutionnelle qui structure le marché MedTech français. La preuve, disait-on, que la France accélérait enfin son déploiement de l’IA en médecine d’urgence.

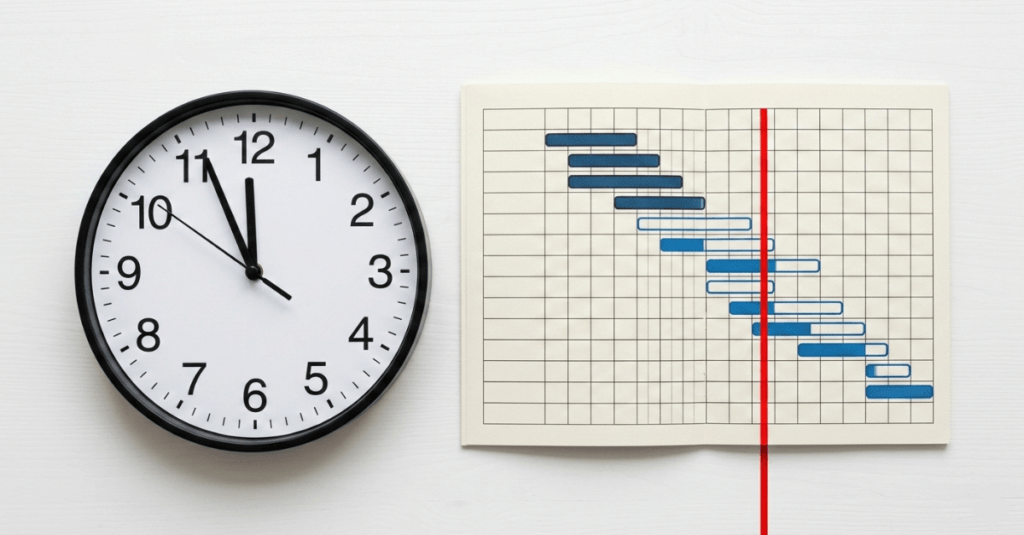

Neuf mois plus tard, en mars 2026, les expérimentations prennent fin. La DGOS publiera le rapport officiel en décembre 2026. Entre les deux : un silence structuré qui devrait alerter tout investisseur positionnant des capitaux sur ce marché.

Ce n’est pas une anomalie passagère. C’est donc un signal de marché, et il mérite d’être analysé comme tel.

1. Ce que l’AMI IA Urgences révèle sur l’opacité institutionnelle du marché

D’un côté, voici ce que les sources officielles sur l’AMI IA Urgences documentent à ce jour :

- Note DGOS du 20 juin 2025 (cadrage administratif général)

- Volume agrégé : 74 établissements, 78 projets, 147 candidatures évaluées

- La liste nominative des 74 établissements lauréats

- Calendrier : fin des expérimentations mars 2026 (RH) et décembre 2026 (Urgences).

De l’autre, voici ce qui reste introuvable dans les sources publiques officielles. Le descriptif des 78 projets financés reste inaccessible. De même, le budget par projet et la grille d’évaluation n’ont pas été publiés. Enfin, aucun rapport d’étape intermédiaire n’est disponible, sept mois après le lancement.

ANAP, G_NIUS (plateforme de la Délégation au Numérique en Santé), les portails ARS co-pilotes, le portail France 2030 : aucun ne documente ces éléments. L’État finance ce dispositif sur fonds publics. Il implique une technologie classée à haut risque par le droit européen. Donc cette invisibilité est un problème réel.

Pour un investisseur évaluant une MedTech ayant participé à l’AMI, l’absence de liste publique des lauréats signifie une chose concrète : vous ne pouvez pas vérifier indépendamment que le dossier commercial est exact.

2. Le problème des « généralisations » prématurées dans les pitches

En décembre 2025, trois mois seulement après le démarrage des expérimentations, plusieurs établissements participants ont annoncé la « généralisation » des solutions testées. Ces annonces ont alimenté des dossiers de levée de fonds et nourri des présentations en conférence.

En effet, la difficulté est de méthode. Une validation clinique robuste suppose quatre étapes : collecte de données, analyse statistique, revue indépendante, validation par comité d’éthique. Ce processus prend entre 12 et 18 mois minimum. Or, l’AMI ayant démarré en juin 2025, des annonces de généralisation en décembre 2025 sont, sur le plan de la rigueur clinique, prématurées.

Deux lectures sont possibles. Première hypothèse : les établissements ont assimilé une extension de POC à une validation pérenne. Seconde hypothèse : des pressions de communication ont conduit à anticiper des conclusions que les données ne permettent pas encore d’établir. Dans les deux cas…

Or, c’est précisément le type de déséquilibre d’information que le financement MedTech français rend structurellement difficile à détecter depuis l’extérieur de l’écosystème.

3. Collision réglementaire août 2026 : quand l’opacité institutionnelle devient risque financier

C’est ici que l’opacité institutionnelle MedTech France prend une dimension systémique rarement intégrée dans les modèles d’investissement.

Le Règlement européen AI Act (UE 2024/1689) classe explicitement les logiciels d’IA utilisés pour le triage médical en urgence comme systèmes à haut risque (Annexe III). La date d’application complète : 2 août 2026.

D’abord, mars 2026 marque la fin des expérimentations AMI. Ensuite, août 2026 impose la deadline AI Act pour les systèmes à haut risque. Enfin, décembre 2026 est la date de restitution officielle.

Pour être conforme, un système IA à haut risque doit disposer d’un Système de Management de la Qualité documenté (12 à 18 mois de mise en place), tracer l’intégralité de sa chaîne de données et garantir un contrôle humain effectif. Pour cela, il doit passé un audit par organisme notifié (6 à 12 mois de délai). Sanctions en cas de non-conformité : jusqu’à 15 millions d’euros ou 3% du CA mondial.

Des solutions déployées via l’AMI avant août 2026 sans conformité AI Act établie exposent leurs éditeurs à un risque réglementaire réel — et leurs investisseurs à une décote de valorisation non anticipée. Les projections de revenus récurrents post-AMI doivent documenter le chemin de certification européenne pour être crédibles.

4. Un pattern récurrent : l’opacité institutionnelle MedTech dépasse l’AMI

L’AMI IA Urgences s’inscrit dans un pattern identifiable à travers plusieurs dispositifs publics français en e-santé. Le programme G_NIUS présente ainsi les mêmes caractéristiques : preuve clinique faible au moment de la sélection, bénéfice organisationnel non démontré, critères de sélection non publiés rendant toute comparaison entre éditeurs impossible.

En conséquence, ce pattern produit un déséquilibre d’information sur le marché MedTech français. Ainsi, les éditeurs sélectionnés dans des AMI bénéficient d’un signal de validation qui influence leur valeur. Or, personne ne peut vérifier publiquement les critères ayant fondé cette sélection. Depuis l’extérieur, il est donc impossible de distinguer une sélection fondée sur la solidité clinique d’une sélection fondée sur d’autres critères.

En réalité, ces dispositifs sont conçus pour financer l’expérimentation — pas pour produire des données exploitables par le marché. C’est l’inverse du modèle allemand DiGA, qui publie systématiquement les données cliniques et les critères d’évaluation, permettant ainsi une comparaison objective entre solutions concurrentes.

5. Estimation des coûts réels : ce que l’opacité institutionnelle dissimule

En l’absence de données officielles, une estimation peut être construite à partir des standards d’intégration hospitalière documentés dans les appels d’offres publics.

En effet, le financement AMI par projet est estimé entre 15 000 et 20 000 euros, bien en dessous du coût réel d’intégration. À titre de comparaison, le coût DSI d’intégration se situe entre 150 000 et 300 000 euros par établissement. Sur 74 établissements, l’enveloppe coûts directs dépasse donc les 11 à 22 millions d’euros, portés en majorité par les établissements eux-mêmes.

Au-delà des coûts directs, il faut ajouter les coûts indirects : dette technique accumulée lors d’intégrations en urgence (coût de remise à niveau dans 18 à 36 mois), coût d’opportunité sur des dossiers non traités (NIS2, EHDS, migration cloud), absence d’apprentissage organisationnel faute de post-mortem public.

Le ratio coût-efficacité réel de l’AMI ne sera calculable qu’en décembre 2026, uniquement si les données sont effectivement publiées, ce qu’aucune obligation formelle ne garantit aujourd’hui.

6. Quatre questions de due diligence face à l’opacité institutionnelle

Concrètement, face à un éditeur MedTech valorisant sa participation à l’AMI, voici les questions qui permettent de séparer la validation solide du signal institutionnel vide :

Premièrement, sur la conformité réglementaire : L’éditeur peut-il documenter son chemin de conformité AI Act (Annexe III) ? A-t-il engagé un organisme notifié ? Son calendrier de marquage CE couvre-t-il les projections de revenus ?

Deuxièmement, sur la validation clinique : Les « généralisations » annoncées reposent-elles sur des données publiées dans une revue à comité de lecture, ou sur des communiqués d’établissements soumis à des pressions de communication ?

Troisièmement, sur la dépendance technologique : La solution repose-t-elle sur une infrastructure cloud souveraine (SecNumCloud) ou sur des services non qualifiés au regard des critères EHDS ? Cette dépendance est-elle déclarée dans les contrats ?

Enfin, sur la reproductibilité : Les résultats pilotes ont-ils été obtenus en conditions de charge opérationnelle réelle (gardes de nuit, surcharge de passages, turnover infirmier) ou en conditions contrôlées non représentatives ?

7. La comparaison européenne : ce que la France n’a pas encore construit

La comparaison européenne est éclairante. L’Allemagne, via DiGA, a validé 64 applications de santé numérique depuis 2020. Les critères d’évaluation sont publiés systématiquement. Les données cliniques sont accessibles publiquement. L’Allemagne conditionne par ailleurs le remboursement à des résultats mesurables sur 12 mois. Ce modèle permet à un investisseur d’évaluer objectivement la valeur d’un label de validation.

De même, le Royaume-Uni publie ses évaluations NICE Evidence Standards Framework avec un niveau de détail comparable. Les Pays-Bas documentent publiquement leurs critères de consentement granulaire pour les données de santé.

Pourtant, la France dispose de volumes de données exceptionnels, d’une base hospitalière solide, d’une expertise clinique reconnue. Ce qu’elle n’a pas encore construit, c’est l’infrastructure de transparence qui permet aux capitaux extérieurs d’évaluer correctement ses actifs d’innovation.

L’opacité institutionnelle MedTech France n’est pas seulement un problème de gouvernance publique. C’est un handicap de compétitivité pour attirer les investissements que l’écosystème mérite.

Conclusion : lire l’opacité comme un signal de marché

Rien dans cet article ne préjuge des résultats réels de l’AMI IA Urgences. Certes, certains projets ont peut-être produit des données cliniques solides et une adoption durable par les équipes soignantes. Toutefois, rendez-vous en décembre 2026.

Ce que cet article établit, c’est qu’en l’état actuel de l’information disponible, la participation à l’AMI est un signal institutionnel — pas une validation clinique. De plus, les risques réglementaires liés à la deadline AI Act d’août 2026 sont réels, mesurables, et largement absents des projections financières présentées aujourd’hui.

L’investisseur qui entre sur le marché MedTech français en 2026 avec les bons cadres analytiques trouve un marché sous-exploré avec un potentiel significatif. Celui qui entre avec les outils conçus pour des marchés plus transparents risque de confondre le bruit institutionnel avec le signal de valeur.

Nicolas Schneider est fondateur de JuliaShift, conseil en résilience opérationnelle du numérique en santé. Expert évaluateur en innovation MedTech pour des dispositifs institutionnels, il intervient comme conférencier et contributeur académique (UPJV, preprint HAL hal-05511769).

Cet article ne constitue pas un conseil en investissement. Les données citées proviennent de sources publiques documentées. Les estimations de coûts s’appuient sur des standards sectoriels publiquement disponibles.